Od hype’u do użytecznego narzędzia – czym dziś jest AI w automatyzacji

Dlaczego „AI” brzmi groźnie, a w praktyce jest zbiorem sprytnych klocków

Określenie „sztuczna inteligencja” często wywołuje skojarzenia z autonomicznymi robotami lub magią, której nie da się kontrolować. W świecie automatyzacji procesów IT i przemysłowych AI jest jednak przede wszystkim zbiorem praktycznych klocków technologicznych, które można układać jak LEGO: jeden moduł do wykrywania anomalii, drugi do przewidywania awarii, trzeci do automatycznych decyzji. Każdy z nich ma jasno określony zakres odpowiedzialności i wymaga konkretnych danych wejściowych.

Podstawowe pojęcia, które porządkują temat:

- AI (Artificial Intelligence) – szeroki parasol określający systemy, które wykonują zadania wymagające „inteligencji” (rozpoznawanie wzorców, podejmowanie decyzji, uczenie się z danych).

- Uczenie maszynowe (ML) – podzbiór AI; modele uczą się na danych, aby przewidywać wyniki lub klasyfikować zdarzenia (np. czy dany wzorzec drgań maszyny oznacza zbliżającą się awarię).

- Model – matematyczna reprezentacja nauczonego zachowania; coś jak skondensowany „doświadczony technik”, tyle że zapisany w parametrach liczbowych.

- Inferencja – faza działania modelu, czyli użycie wytrenowanego modelu do podejmowania decyzji w czasie rzeczywistym (np. „wygeneruj alert”, „przełącz ruch sieciowy”).

- MLOps – zestaw praktyk i narzędzi do wdrażania i utrzymywania modeli ML w środowisku produkcyjnym, podobnie jak DevOps dla aplikacji.

- AIOps – wykorzystanie AI do automatyzacji i wspierania operacji IT: monitoringu, zarządzania incydentami, analizy logów.

Gdy rozłoży się projekt AI na takie klocki, nagle przestaje on być mitycznym „czarnym pudełkiem”, a staje się kolejnym systemem, który trzeba zaplanować, zasilić danymi, wdrożyć i utrzymać. Z tą różnicą, że zamiast twardych reguł if/then masz model oparty na statystyce i prawdopodobieństwie.

Różnica między prostą automatyzacją a automatyzacją „inteligentną”

Klasyczna automatyzacja IT i procesów przemysłowych opiera się na sztywnych regułach. Mamy zestaw warunków i wynikających z nich akcji: jeśli temperatura przekroczy 80°C – wyłącz linię; jeśli CPU > 90% przez 5 minut – wyślij alert do administratora. Takie podejście jest przewidywalne, ale ma poważną wadę: działa tylko tam, gdzie da się z góry przewidzieć wszystkie warianty.

Automatyzacja „inteligentna” działa inaczej. Zamiast setek ręcznie pisanych reguł, model uczy się na danych, jak wyglądają typowe sytuacje oraz jak wyglądają sytuacje problemowe. Przykład:

- Prosta automatyzacja: „jeśli serwer nie odpowiada 3 razy pod rząd na ping – zrestartuj usługę”.

- Inteligentna automatyzacja: model analizuje historię metryk (CPU, IO, pamięć), logi systemowe i ruch sieciowy, aby przewidzieć dużą degradację wydajności na 30 minut przed faktycznym problemem, i z wyprzedzeniem skaluje klaster lub przełącza ruch.

Granica między jednym a drugim często przebiega tam, gdzie zaczynają dominować nieregularne wzorce, nie dające się łatwo opisać prostymi zasadami. Wtedy AI zaczyna mieć sens – nie jako zastępstwo automatyzacji, ale jako jej rozszerzenie w obszarach, gdzie logika „twardych reguł” zawodzi albo wymagałaby setek wyjątków.

Backup vs. system przewidujący awarie – krótkie porównanie

Spójrzmy na konkretny przykład z codziennej pracy administratora. Regularny backup baz danych to klasyczna automatyzacja: o 2:00 w nocy uruchamia się skrypt, który wykonuje kopie, sprawdza checksumy i odsyła log z wynikiem. Nic odkrywczego, ale działa niezawodnie od lat.

Teraz kontrast: system AI śledzi obciążenie dysków, opóźnienia zapisu, liczbę błędów I/O, temperaturę oraz zmiany w konfiguracji. Na tej podstawie model uczy się, jakie wzorce poprzedzały awarie dysków i nieplanowane restarty maszyn. Po pewnym czasie jest w stanie z odpowiednim wyprzedzeniem wygenerować ostrzeżenie: „Ryzyko awarii węzła X w ciągu najbliższych 24 godzin jest podwyższone”. To z kolei może automatycznie uruchomić akcję: wykonanie dodatkowego backupu, migrację maszyn wirtualnych, wcześniejszą wymianę dysku.

W pierwszym scenariuszu automatyzacja reaguje zawsze tak samo, niezależnie od kontekstu. W drugim – zachowanie zależy od danych, a model adaptuje się, gdy środowisko się zmienia.

Co realnie potrafią obecne systemy AI, a czego jeszcze nie

W realnych wdrożeniach automatyzacji procesów IT i przemysłowych AI radzi sobie dobrze z zadaniami, które polegają na:

- rozpoznawaniu wzorców w dużej liczbie danych (metryki, logi, drgania, obrazy z kamer),

- wykrywaniu odchyleń od „normalnego” zachowania (anomalie),

- przewidywaniu wartości w przyszłości (obciążenie, czas życia komponentu, zapotrzebowanie na energię),

- klasyfikacji (czy ten produkt jest OK, czy ma wadę; czy to incydent sieciowy, czy aplikacyjny).

Dużo słabiej sprawdza się tam, gdzie trzeba rozumieć szerszy kontekst biznesowy, prowadzić złożone negocjacje lub podejmować decyzje etyczne. W automatyzacji procesów oznacza to, że AI obecnie świetnie pomaga operatorom, ale jeszcze długo nie będzie ich w pełni zastępować. Rola ludzi przesuwa się natomiast z wykonywania powtarzalnych zadań w stronę nadzoru, kalibracji i projektowania procesów, w które AI jest „wszyta”.

Gdzie AI „czuje się najlepiej” – typowe obszary zastosowań w IT i przemyśle

Procesy IT, które aż proszą się o wsparcie AI

W większości organizacji IT istnieją obszary, w których zespoły operacyjne od dawna toną w danych: wykresy, logi, alerty, bilety serwisowe. Idealne środowisko dla AI, bo człowiek nie jest w stanie na bieżąco przeanalizować tysięcy metryk co sekundę, a model – tak.

Najczęstsze zastosowania sztucznej inteligencji w automatyzacji procesów IT to:

- Monitoring infrastruktury z AI – detekcja anomalii w czasie rzeczywistym w setkach metryk systemowych (CPU, RAM, I/O, latencje), bez konieczności ustawiania progów dla każdej z nich.

- Automatyczne reakcje na incydenty – połączenie AIOps z runbookami i automatycznymi skryptami, które potrafią same wykonać część działań naprawczych.

- Analiza logów z uczeniem maszynowym – grupowanie podobnych zdarzeń, wykrywanie wzorców poprzedzających awarie, usuwanie „szumu” z alertów.

- Prognozowanie obciążenia – przewidywanie zapotrzebowania na zasoby (serwery, pasmo, storage), co pomaga planować zakupy sprzętu lub autoskalowanie chmury.

AI zaczyna tu od roli „mądrego filtra”, który wyławia rzeczy istotne z natłoku danych. Z czasem te same mechanizmy można podpiąć do systemów automatyzacji (Ansible, Terraform, systemy orkiestracji), i wtedy model nie tylko wykrywa, ale też inicjuje działania w infrastrukturze.

Obszary produkcyjne i utrzymaniowe, w których AI daje przewagę

W przemyśle dane powstają na każdym kroku: falowniki raportują prąd, czujniki drgań śledzą łożyska, kamery obserwują produkty na taśmie, systemy MES zbierają historię zleceń. W większości zakładów ta kopalnia informacji jest wykorzystywana bardzo fragmentarycznie.

Typowe obszary, gdzie sztuczna inteligencja w przemyśle daje szybki, mierzalny efekt:

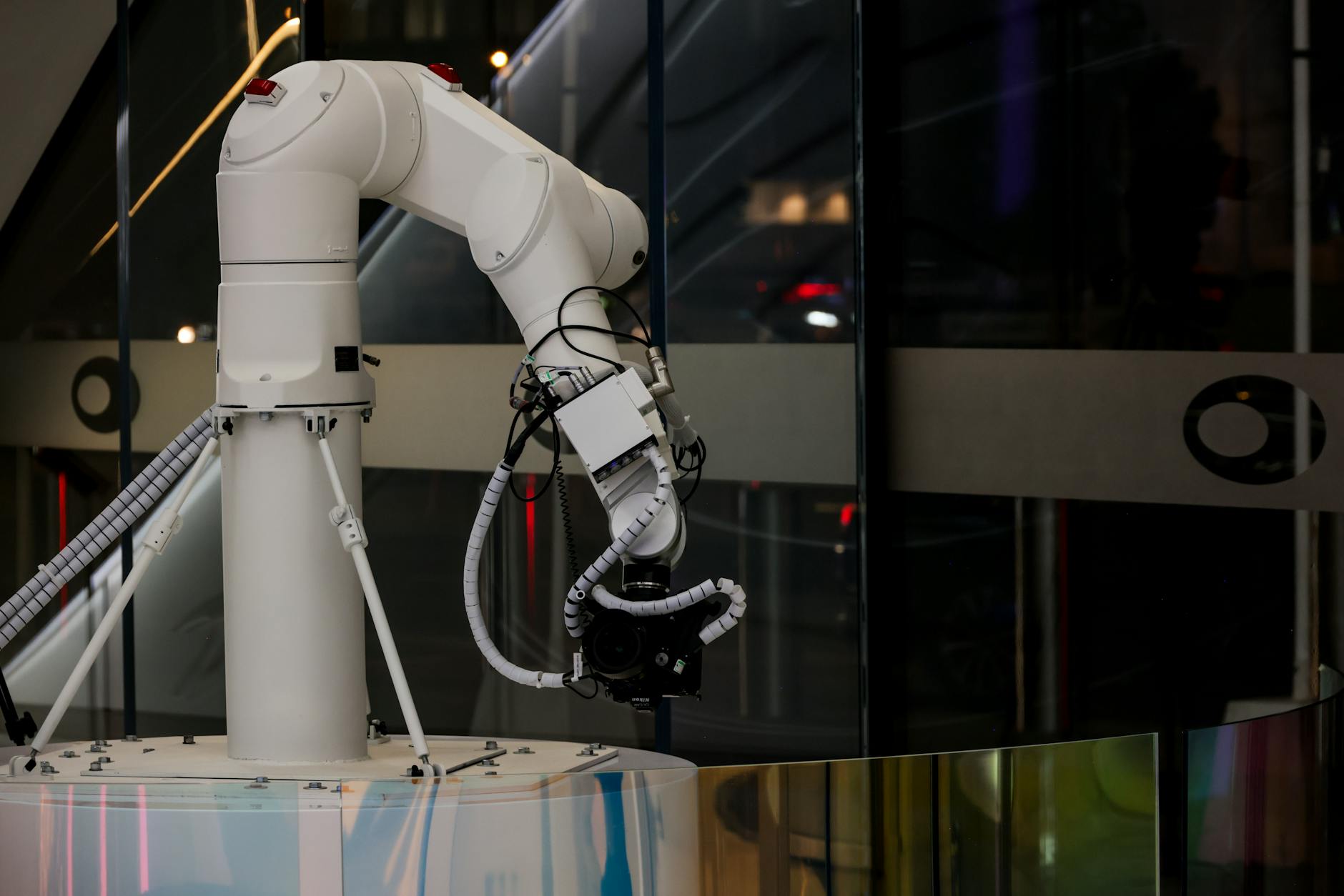

- Systemy predykcyjnego utrzymania ruchu – przewidywanie awarii maszyn na podstawie drgań, temperatur, hałasu, prądu, liczby cykli.

- Kontrola jakości z wizją komputerową – automatyczne wykrywanie wad produktów na liniach produkcyjnych, rozpoznawanie nieprawidłowego montażu, błędów etykietowania.

- Optymalizacja parametrów procesu – dobór ustawień (temperatury, prędkości, ciśnień) tak, aby zmniejszyć zużycie energii lub ilość odpadów, bez utraty jakości.

- Cyfrowy bliźniak linii produkcyjnej – model symulujący zachowanie procesu, który pozwala testować scenariusze „co jeśli” bez zatrzymywania zakładu.

Z perspektywy automatyzacji najciekawsze są kombinacje: np. model przewiduje, że w ciągu 8 godzin wzrośnie liczba braków na określonym stanowisku, więc system automatycznie wysyła zlecenie kontroli do technika i sugeruje korektę ustawień maszyny.

Klasyfikacja typowych zadań dla AI: predykcja, anomalie, obrazy, NLP

Żeby łatwiej dopasować narzędzia do problemu, dobrze jest spojrzeć na zastosowania AI przez pryzmat kilku typów zadań:

- Predykcja (prognozowanie) – przewidywanie wartości liczbowej w przyszłości (obciążenie CPU, zużycie energii, czas życia łożyska). Bazuje głównie na szeregach czasowych.

- Detekcja anomalii – wskazywanie, że aktualne zachowanie różni się „znacząco” od historycznej normy (dziwny ruch sieciowy, nietypowe drgania, skok temperatury w określonym trybie pracy).

- Klasyfikacja obrazów i sygnałów – rozpoznawanie, co znajduje się na obrazie (produkt OK/NOK, typ wady), klasyfikacja dźwięków (nietypowe brzmienie łożyska, sygnał alarmowy).

- NLP (przetwarzanie języka naturalnego) – praca z tekstem: zgłoszenia do helpdesku, maile od użytkowników, opisy awarii, notatki z przeglądów.

Większość praktycznych rozwiązań automatyzujących procesy IT i przemysłowe to po prostu dobrze skomponowana mieszanka tych czterech typów zadań, otoczona integracją z istniejącymi systemami i procesami.

Od danych do działania – jakie dane są potrzebne, by AI miała sens

Dane w IT: logi, metryki, zdarzenia, bilety serwisowe

Bez danych automat jest ślepy, a model ML – bezużyteczny. W środowisku IT fundamentem są cztery główne grupy danych:

- Metryki czasowe – CPU, RAM, I/O, opóźnienia, liczba zapytań, błędy 4xx/5xx, liczba wątków. Zbierane w systemach typu Prometheus, Zabbix, Datadog.

- Logi – systemowe, aplikacyjne, bezpieczeństwa, logi sieciowe; często zcentralizowane w Elastic, Splunk, Loki czy innych SIEM-ach.

- Zdarzenia i alerty – informacje z monitoringu, systemów bezpieczeństwa, narzędzi chmurowych, które już są w pewien sposób przetworzone.

- Bilety serwisowe i incydenty – dane z Jiry, ServiceNow, systemów helpdeskowych: opisy zgłoszeń, priorytety, czas rozwiązania, kategorie.

W automatyzacji procesów IT dane te łączy się w jedną „oś czasu”. Przykładowo: model do detekcji anomalii uczy się, jak wyglądał profil metryk tuż przed incydentami, które trafiły do systemu zgłoszeniowego. Dzięki temu później potrafi ostrzec, że obecne zachowanie przypomina okres „tuż przed awarią”.

Dane w przemyśle: czujniki, PLC, SCADA, MES, ERP

W zakładzie przemysłowym mapa danych jest bogatsza, ale też mocniej rozproszona. Najczęściej spotykane źródła:

- Czujniki i PLC – surowe sygnały z maszyn (wibracje, temperatura, prąd, ciśnienie), sterowane przez sterowniki PLC i napędy.

- SCADA – systemy nadzoru i akwizycji danych, które wizualizują parametry procesów i przechowują historię.

- MES – Manufacturing Execution System, czyli „mózg” produkcji: zlecenia, statusy, wydajność, przestoje.

- ERP – planowanie zasobów przedsiębiorstwa: zamówienia, magazyny, planowanie produkcji, koszty.

Dla AI kluczowe jest, aby dało się skorelować dane procesowe (np. drgania, temperatura na maszynie) z efektem biznesowym (np. liczba braków, zatrzymania linii). Dopiero wtedy modele predykcyjne mają sens – potrafią związać zachowanie maszyny z rzeczywistą awarią czy spadkiem jakości, a nie tylko „dziwnym” wykresem.

Dużym wyzwaniem bywa samo „sprzątnięcie” tych danych. Czujniki różnych generacji, kilka systemów SCADA, osobny historian u każdego dostawcy linii, do tego MES przerabiany od lat – to codzienność wielu zakładów. Zanim pojawi się pierwszy model ML, trzeba zadbać o spójne słowniki, identyczne oznaczenia maszyn, jasne definicje przestojów czy braków. Bez tego model niby coś liczy, ale każdy dział rozumie wynik po swojemu.

Dobrym podejściem jest zaczynanie od wąskiego wycinka procesu, w którym łatwo zdefiniować „sukces”. Na przykład: jedna linia pakowania, jeden typ produktu, jasno opisane typy wad. Tam integruje się sygnały z PLC, historię z SCADA i wyniki kontroli jakości z MES, a dopiero potem myśli o skalowaniu na resztę fabryki. Dzięki temu zespół szybko uczy się, jakich danych brakuje, gdzie giną informacje i jakie poprawki procesowe trzeba wprowadzić, aby AI miała się na czym oprzeć.

W praktyce najwięcej pracy idzie nie w „magiczne algorytmy”, tylko w budowę mostów między systemami. Często prosty mechanizm: ETL do hurtowni danych, warstwa semantyczna opisująca maszyny i procesy, kilka dobrze przemyślanych widoków czasowych – daje więcej niż kolejny, coraz bardziej wyrafinowany model. Dopiero na takim fundamencie AI może wchodzić krok po kroku w automatyzację: od rekomendacji po samoczynne wydawanie komend do sterowników czy systemów klasy DCS, oczywiście z rozsądnymi zabezpieczeniami i mechanizmem „kill switch”.

Rozbudowane środowiska IT – szczególnie tam, gdzie buduje się portale developerskie czy platformy self-service – bardzo szybko dochodzą do ściany, jeśli nie użyją AI do okiełznania złożoności. Kto rozwija takie środowisko, ten zwykle interesuje się, gdzie znaleźć więcej o IT z perspektywy nowych technologii, aby wiedzieć, jakie klocki można ze sobą połączyć.

Jeżeli dane w IT i w przemyśle są spięte z realnym działaniem – skryptem naprawczym, zmianą nastawy, zleceniem dla technika – sztuczna inteligencja przestaje być ciekawostką i zaczyna zachowywać się jak dodatkowy, bardzo czujny członek zespołu. Analizuje tysiące sygnałów, nie męczy się i nie zasypia na nocnej zmianie, a człowiek może wreszcie skupić się na tym, co rzeczywiście ludzkie: decyzjach, priorytetach i odwadze, żeby czasem zmienić zasady gry, a nie tylko szybciej gasić pożary.

Praktyczne przypadki użycia w IT – od monitoringu do samo‑naprawiającej się infrastruktury

Inteligentny monitoring: od zalewu alertów do kilku „alertów‑konkluzji”

W klasycznym monitoringu każdy komponent krzyczy osobno: baza danych, aplikacja, load balancer, storage. Gdy coś pójdzie nie tak, w ciągu minuty pojawia się kilkadziesiąt powiadomień i nikt nie wie, od czego zacząć. Modele oparte na detekcji anomalii i analizie korelacji potrafią z tych wielu sygnałów złożyć jedną, strawniejszą historię.

Mechanizm wygląda często tak: AI obserwuje metryki z różnych warstw stosu (aplikacja, baza, sieć, system operacyjny) oraz logi. Gdy widzi, że w podobnym „wzorku” danych w przeszłości kończyło się to konkretnym incydentem, łączy rozproszone alerty w jeden „alert‑konkluzję” z hipotezą przyczyny. Operator nie dostaje więc 40 komunikatów o problemach z CPU, opóźnieniem i timeoutami, tylko jedno zdarzenie: „prawdopodobny problem z indeksami w bazie X – spodziewany wzrost błędów 5xx w usłudze Y”.

Taki system można dodatkowo zasilić historią zgłoszeń z helpdesku. Jeśli na przykład przed każdym większym incydentem użytkownicy zgłaszali „aplikacja wolno działa w godzinach porannych”, model zaczyna to traktować jako wczesne ostrzeżenie, a nie „miękki” sygnał do zignorowania.

Triaging i kategoryzacja zgłoszeń z pomocą NLP

W większych organizacjach samo posortowanie zgłoszeń bywa większym wyzwaniem niż ich rozwiązanie. Jeden użytkownik opisuje problem technicznie, inny emocjonalnie, a kolejny tylko pisze „nie działa”. NLP potrafi z tego chaosu wyciągnąć strukturę: rozpoznać temat, pilność, potencjalną jednostkę odpowiedzialną.

Modele uczone na historycznych ticketach klasyfikują nowe zgłoszenia do odpowiednich kategorii, sugerują priorytet i podpowiadają, który zespół powinien przejąć sprawę. Jeżeli firma ma rozbudowaną bazę wiedzy, ten sam model potrafi także zaproponować kilka najbardziej prawdopodobnych artykułów, które już wcześniej pomogły w podobnych sytuacjach. Efekt? Krótszy czas od pojawienia się problemu do pierwszej sensownej reakcji, nawet bez rozbudowy działu wsparcia.

Ciekawym zastosowaniem jest wyszukiwanie „ukrytych trendów” w opisach zgłoszeń. AI widzi, że w ostatnich tygodniach użytkownicy coraz częściej narzekają na wolne logowanie po aktualizacji określonej przeglądarki, choć nikt jeszcze nie powiązał faktów. Dział IT dostaje sygnał, zanim skala problemu stanie się kryzysem wizerunkowym.

Systemy rekomendacji dla administratorów i SRE

Administrator, który dobrze zna swoją infrastrukturę, zwykle ma w głowie katalog prostych „mikro‑recept”: co zrestartować, co przełączyć, które zasoby powiększyć. AI może taki katalog z czasem zbudować automatycznie. Łącząc dane o incydentach, metryki i przebieg działań naprawczych, model uczy się: przy jakim wzorcu objawów zadziałał konkretny playbook Ansible, które kroki były zbędne, a które kluczowe.

W praktyce w panelu operatora pojawiają się sugestie: „przy podobnych objawach zastosowano wcześniej procedurę A – średni czas przywrócenia usługi: 12 minut”. Człowiek nadal decyduje, czy kliknąć „uruchom teraz”, czy jednak najpierw coś sprawdzić, ale ma pod ręką skondensowaną wiedzę z wielu poprzednich zdarzeń, nie tylko własne doświadczenie.

Jeśli organizacja jest gotowa na dalszą automatyzację, niektóre z tych rekomendacji mogą przejść w tryb pół‑automatyczny: na przykład uruchamiają akcję, ale wymagają zatwierdzenia przez dyżurnego, gdy dotyczy krytycznego systemu. Z czasem granica między rekomendacją a automatycznym działaniem przesuwa się, w miarę jak rośnie zaufanie do skuteczności konkretnych playbooków.

Samoregulująca się infrastruktura: autoskalowanie „na sterydach”

Klasyczne autoskalowanie w chmurze reaguje na proste sygnały – wzrost obciążenia CPU, liczby zapytań, czas odpowiedzi. Modele predykcyjne pozwalają „wyprzedzić” ruch. Zamiast czekać, aż serwery zaczną się dusić, analiza szeregów czasowych przewiduje, że za dwadzieścia minut nadejdzie typowy „poranny szczyt” albo że właśnie startuje kampania marketingowa, która zwykle kończy się zwiększonym ruchem na konkretnych usługach.

Taka logika może wchodzić głębiej niż warstwa samego autoskalera. AI potrafi sugerować zmianę klasy maszyn (np. przejście na instancje zoptymalizowane pod pamięć), inny rozkład ruchu pomiędzy regionami, a nawet wpływać na kolejkę zadań wsadowych tak, żeby nie konkurowały z ruchem interaktywnym. Jeśli infrastruktura jest zdefiniowana jako kod, model może wygenerować propozycję zmian w Terraformie lub innej deklaratywnej definicji i przekazać ją do przeglądu inżynierowi.

W jednej z firm e‑commerce proste przewidywanie ruchu połączone z inteligentnym skalowaniem API pozwoliło zrezygnować z utrzymywania ogromnego „zapasu” serwerów na wszelki wypadek. Zamiast stałej nadmiarowości, zasoby podążają za przewidywanym popytem z dokładnością kilku minut.

Bezpieczeństwo: od surowych logów do „co rzeczywiście jest podejrzane”

Obszar bezpieczeństwa IT generuje jedne z największych wolumenów danych: logi z firewalli, systemów IDS/IPS, EDR na stacjach roboczych, chmurowe logi dostępu. Żaden analityk SOC nie jest w stanie „ręcznie” przejrzeć choćby ułamka tych informacji. AI staje się tutaj filtrem, który wyławia zachowania naprawdę niestandardowe.

Detekcja anomalii w ruchu sieciowym, uczenie się typowych wzorców logowania w organizacji, rozpoznawanie nietypowych sekwencji działań użytkownika – to wszystko pomaga zobaczyć potencjalny incydent zanim doprowadzi do realnej szkody. Model może na przykład zauważyć, że użytkownik, który zwykle pracuje w godzinach biurowych z jednego miasta, nagle loguje się w nocy z innego kontynentu, a chwilę później próbuje pobrać duże ilości danych z repozytorium kodu.

Na tym nie trzeba kończyć. Automatyzacja reakcji pozwala automatycznie zawęzić uprawnienia, wymusić ponowną autoryzację lub tymczasowo zablokować konto, jeśli ryzyko jest wysokie. Decyzja o pełnym „odcięciu” może nadal należeć do człowieka, ale AI może już w pierwszych sekundach po wykryciu podejrzanego zachowania wygasić najgroźniejsze wektory ataku.

Asystenci dla DevOps i platform teams

Coraz częściej zespoły odpowiedzialne za platformy developerskie traktują AI jak dodatkowego kolegę, który „siedzi nad ramieniem” i podpowiada. Asystent zasilany dokumentacją infrastruktury, schematami sieci, opisami usług i historycznymi incydentami może odpowiadać na pytania typu: „który mikroserwis odpowiada za płatności kartą?”, „gdzie w logach najlepiej szukać przyczyn błędów 500 w usłudze X?”, „jak wyglądała podobna awaria pół roku temu?”.

Z technicznego punktu widzenia to połączenie wyszukiwarki semantycznej z modelem językowym, który zna kontekst organizacji. Zamiast przeszukiwać kilkanaście repozytoriów i wiki, inżynier dostaje skondensowaną odpowiedź z cytatami źródłowymi. Gdy takie narzędzie zostanie spięte z automatyzacją (np. pipeline’ami CI/CD), może nie tylko podpowiadać, ale też wygenerować szkic zmiany w konfiguracji, którą ktoś następnie przejrzy i wdroży.

Praktyczne przypadki użycia w przemyśle – fabryka, która „słucha” swoich maszyn

Predykcyjne utrzymanie ruchu jako codzienna praktyka, a nie projekt „R&D”

Predykcyjne utrzymanie ruchu kojarzy się często z dużymi, jednorazowymi projektami i skomplikowanymi modelami. Tymczasem wiele zakładów zaczyna od bardzo prostych kroków: dodatkowe czujniki wibracji na kluczowych silnikach, streaming danych do centralnego systemu, pierwszy model uczony na kilku miesiącach historii.

Model nie musi od razu przewidywać dokładnej daty awarii. Czasem wystarczy, że sygnalizuje „odklejanie się” maszyny od normalnego profilu pracy. Utrzymanie ruchu dostaje kilka dni czy tygodni na zaplanowanie przestoju w dogodnym momencie, zamówienie części i przygotowanie brygad. Zamiast nocnych interwencji i nerwowych telefonów, awarie krytycznych elementów przechodzą w planowe działania.

W jednej z firm produkcyjnych pierwszym sukcesem było wykrycie narastających drgań na niewielkim silniku przenośnika – elemencie tak tanim, że nikt wcześniej nie inwestował w jego monitoring. Okazało się jednak, że nieplanowane zatrzymanie całej linii z powodu tej drobnej awarii kosztuje wielokrotnie więcej niż prosty zestaw czujników i podstawowy model analizy.

Kontrola jakości z kamerami, które naprawdę „rozumieją” proces

Systemy wizyjne funkcjonują w fabrykach od lat, ale często działają na sztywnych regułach: progi jasności, rozmiar obiektu, proste maski. AI wprowadza elastyczność – model uczy się, jak powinien wyglądać poprawny produkt, a potem odróżnia subtelne wady od naturalnej zmienności.

Takie podejście szczególnie dobrze sprawdza się tam, gdzie klasyczne reguły są trudne do utrzymania. Na przykład w przemyśle spożywczym wygląd produktu naturalnie się zmienia, ale doświadczony operator „po prostu widzi”, że coś jest nie tak. Sieci neuronowe można nauczyć podobnej intuicji, na bazie tysięcy zdjęć produktów OK i NOK, wraz z opisami rodzaju wady.

AI może nie tylko oznaczyć produkt do odrzutu, ale też skojarzyć typ wady z określonymi parametrami procesu: temperaturą, prędkością taśmy, konkretną zmianą. To z kolei pozwala reagować bliżej źródła problemu, zamiast tylko zwiększać kontrolę końcową. Jeśli system widzi, że dany typ deformacji częściej pojawia się przy określonym ustawieniu pieca, sugeruje korektę receptury albo wcześniej sygnalizuje potrzebę przeglądu.

Optymalizacja receptur i parametrów procesu w czasie rzeczywistym

W wielu zakładach ustawienia maszyn bazują na doświadczeniu kilku kluczowych technologów. Gdy są na miejscu – wszystko działa świetnie. Gdy zmienia się obsada albo startuje nowa linia, zaczyna się żmudne „dostrajanie” parametrów. Modele uczenia maszynowego mogą te doświadczenia przechwycić i uogólnić.

Model regresyjny lub reinforcement learning analizuje, jak zmiany temperatury, prędkości, ciśnienia i innych nastaw przekładają się na wskaźniki jakości i zużycie energii. Następnie podpowiada operatorom, jakie korekty wprowadzić, by utrzymać jakość przy mniejszym koszcie lub zredukować ilość braków. W prostszej wersji system działa jako „nawigacja” – sugeruje parametry, ale nie steruje maszyną. W bardziej zaawansowanych wdrożeniach może bezpośrednio wysyłać zmiany do sterowników, w określonych, dobrze przetestowanych przedziałach.

Przykładowo: w hucie szkła AI analizuje kształt wytwarzanych butelek z kamer, temperaturę pieca i tempo linii. Zamiast ręcznie co chwilę korygować ustawienia, operator dostaje rekomendacje na panelu HMI: „obniż temperaturę o 5 stopni, zwiększ prędkość formowania o 3% – oczekiwany spadek odrzutów o kilka punktów procentowych”. Jeśli zakład ma zaufanie do modelu, te korekty mogą następnie stać się częścią w pełni automatycznej pętli sterowania.

Cyfrowy bliźniak linii produkcyjnej jako poligon doświadczalny

Cyfrowy bliźniak to nie tylko modny termin, ale praktyczne narzędzie: symulator realnej linii produkcyjnej, zasilany danymi z czujników i systemów sterowania. AI pełni tu rolę silnika, który „domyka” luki między prostą symulacją a rzeczywistym zachowaniem maszyn.

W tym miejscu przyda się jeszcze jeden praktyczny punkt odniesienia: Self‑service dla developerów: portale deweloperskie, szablony i standaryzacja środowisk.

Na takim bliźniaku można testować scenariusze, których nikt nie odważyłby się spróbować w prawdziwej fabryce: nagłe zmiany prędkości, nowe kombinacje produktów, inne harmonogramy przestojów. Model uczony na historycznych danych z linii potrafi przewidywać, jak zmiany wpłyną na OEE, zużycie energii czy ryzyko przestojów. Dzięki temu planowanie inwestycji (np. dołożenie kolejnego robota, zmiana layoutu linii) odbywa się w oparciu o liczby, a nie tylko intuicję.

Cyfrowy bliźniak szczególnie dobrze współgra z automatyzacją. Jeżeli zakład planuje wdrożyć nowe algorytmy sterowania, najpierw można je „przepuścić” przez bliźniaka: sprawdzić, jak reagują na zakłócenia, gdzie się mylą, przy jakich parametrach stają się niestabilne. Dopiero gdy przejdą taką wirtualną kwalifikację, trafiają na prawdziwą linię, zazwyczaj już z dużo mniejszą liczbą niespodzianek.

Logistyka wewnętrzna: wózki, AGV i magazyny sterowane przez dane

Automatyzacja w fabryce to nie tylko maszyny produkcyjne, ale też cała logistyka wewnętrzna. Rozkład tras wózków widłowych, ruch AGV, uzupełnianie buforów przy liniach – te wszystkie procesy generują dane, które AI może wykorzystać do usprawnienia przepływu materiałów.

Modele optymalizacyjne uczone na historii zamówień, stanów magazynowych i czasach przejazdów proponują lepsze harmonogramy i trasy. Mogą na przykład zasugerować inny sposób grupowania zleceń, tak aby ograniczyć puste przejazdy, albo zasilić system WMS predykcją, gdzie i kiedy zabraknie kluczowych komponentów. Dzięki temu AGV nie krążą „w kółko”, tylko jadą tam, gdzie faktycznie będą potrzebne za chwilę.

Do tego dochodzi komunikacja między systemem magazynowym a produkcją. Jeżeli planista zmieni kolejność zleceń na linii, AI może od razu przeliczyć zapotrzebowanie materiałowe i wysłać AGV z odpowiednimi komponentami we właściwe miejsca. Zamiast „gaszenia pożarów” i ręcznego przesuwania palet, magazyn i produkcja działają jak zsynchronizowana orkiestra – każdy wie, kiedy jest jego wejście.

Przy dobrze zebranych danych da się pójść o krok dalej i prognozować zatory, zanim faktycznie powstaną. Model przewiduje, że za godzinę trzy linie jednocześnie poproszą o ten sam rodzaj komponentów i już teraz przekierowuje część wózków w ich okolice. Operatorzy nie muszą śledzić dziesiątek ekranów; widzą prostą wizualizację obciążenia i sugestie systemu, gdzie przesunąć zasoby lub jak zmienić priorytety zleceń.

AI pomaga też w mniej spektakularnych, ale bardzo kosztownych drobiazgach: identyfikacji miejsc, gdzie wózki notorycznie czekają na rozładunek, wykrywaniu nieoptymalnych lokalizacji regałów czy wskazywaniu „wąskich gardeł” przy dokach. Te informacje łatwo przekuć na konkretne działania – inną organizację stref, nowe reguły kompletacji czy drobne inwestycje w dodatkowe stanowiska.

Patrząc z boku, może się wydawać, że to kolejna fala cyfryzacji, która „kiedyś” do nas dotrze. W praktyce wiele opisanych tu rozwiązań da się zacząć małymi krokami: od prostszych modeli, pojedynczej linii, jednego procesu w IT czy jednym magazynie. Tam, gdzie automatyzacja spotyka się z mądrze użytym AI, zaczynają dziać się rzeczy, które jeszcze niedawno wymagałyby całych zespołów ludzi – a dziś można je rozpisać w postaci algorytmu i spokojnie włączyć do codziennej pracy.

Jak przygotować organizację na AI w automatyzacji – ludzie, procesy, odpowiedzialność

Od „tajemnej magii” do wspólnego języka z biznesem i utrzymaniem ruchu

Najbardziej zaawansowany model nic nie zmieni, jeśli osoby odpowiedzialne za produkcję, utrzymanie ruchu czy infrastrukturę IT nie rozumieją, co ten model robi i jak z niego korzystać. „AI” często brzmi jak czarna skrzynka, a wtedy naturalną reakcją jest ostrożność – albo ciche ignorowanie wyników.

Dlatego pierwszym krokiem jest wspólny język. Inżynier procesu nie musi znać szczegółów architektury sieci neuronowej, ale powinien wiedzieć, co oznacza „model anomalii”, czym jest „próg zaufania”, dlaczego czasem pojawiają się fałszywe alarmy. Z drugiej strony zespół data science musi usłyszeć od technologów, jakie alerty są realnie użyteczne, a które tylko zaśmiecą ekran.

Dobrą praktyką jest krótkie, warsztatowe podejście: wspólny przegląd kilku realnych przypadków z linii lub centrum danych, na których widać, jak AI „patrzy” na wykresy i logi, a jak robią to ludzie. Po godzinie takiej rozmowy sceptycy często zaczynają proponować własne pomysły na kolejne modele.

Role i odpowiedzialności – kto „posiada” modele w organizacji

Automatyzacja z AI wprowadza nowy typ zasobu: model, który stale się uczy i zmienia. Trzeba więc zadać bardzo przyziemne pytania: kto odpowiada za jego aktualizację, kto zatwierdza nowe wersje, kto reaguje, gdy zaczyna się mylić?

W praktyce sprawdza się podział na trzy grupy:

- Właściciel biznesowy – np. kierownik utrzymania ruchu, szef produkcji, menedżer odpowiedzialny za infrastrukturę IT. To on decyduje, jakie wskaźniki są kluczowe i czy model faktycznie pomaga w ich poprawie.

- Opiekun techniczny modelu – zespół data science lub inżynier ML, który rozwija model, dba o dane, mierzy jakość predykcji, pilnuje wersjonowania.

- Integrator z systemami – inżynier automatyki, architekt systemów IT lub DevOps, który „wpina” model w istniejące narzędzia: SCADA, MES, CMMS, systemy monitoringu i orkiestracji.

Tak prosta „mapa odpowiedzialności” ogranicza klasyczne zjawisko przerzucania się winą: AI źle prognozuje, bo ma słabe dane; dane są słabe, bo nikt nie zadbał o czujniki; czujniki nie działają, bo… to nie dział IT. Gdy każdy zna swoją rolę, łatwiej rozwiązywać problemy, zanim urosną do rangi kryzysu.

Zmiana sposobu pracy operatorów i inżynierów

AI rzadko zastępuje ludzi z dnia na dzień. Częściej zmienia zakres ich pracy. Operator, który do tej pory przez pół zmiany obserwował wskaźniki, zaczyna więcej czasu spędzać na diagnozie przyczyn alarmów i wdrażaniu ulepszeń. Administrator systemu, zamiast ręcznie przeklikiwać logi, skupia się na tym, jak poprawić reguły automatycznego reagowania.

Żeby ta zmiana nie budziła lęku, dobrze jest od początku podkreślić, że model ma być „drugą parą oczu”, a nie następcą człowieka. Dobrym sposobem jest okres przejściowy, gdy AI wyłącznie rekomenduje działania, a człowiek podejmuje ostateczną decyzję. Dzięki temu zespoły uczą się ufać (albo nie ufać) konkretnym typom rekomendacji.

W jednej z firm logistycznych pierwszy system predykcji awarii wózków jezdniowych działał przez kilka miesięcy wyłącznie w trybie „shadow mode”: generował prognozy, ale nie wpływał na plan serwisów. Serwisanci porównywali swoje decyzje z sugestiami modelu. Gdy zobaczyli, że w części przypadków model faktycznie „uprzedzał” ich o problemie, sami poprosili o włączenie automatycznych zgłoszeń do CMMS.

Architektura techniczna – jak sensownie wpiąć AI w istniejące systemy

AI jako „nakładka” na obecne narzędzia, a nie wielka wymiana systemu

Wielu szefów IT i produkcji obawia się, że wykorzystanie AI oznacza rewolucję: wymianę SCADA, modernizację całego systemu ERP, przebudowę architektury sieci. Tymczasem w większości udanych wdrożeń AI wchodzi jako warstwa pośrednia, wykorzystująca istniejące źródła danych i kanały komunikacji.

Przykładowy schemat jest prosty: z jednej strony dane z PLC, SCADA, systemów MES, CMMS czy platform monitorujących infrastrukturę IT; pośrodku warstwa integracji (broker zdarzeń, API, czasem prosty middleware), z drugiej strony – usługa AI, wystawiająca przewidywania lub rekomendacje. Końcowy użytkownik nadal pracuje w znanym sobie narzędziu, tylko okienko alarmów lub panel parametrów wzbogaca się o dodatkowe „podpowiedzi” z modelu.

Taki podejście chroni przed paraliżem decyzyjnym. Nie trzeba od razu planować pięcioletniego programu wymiany wszystkich systemów – można zacząć od jednego sensownie zintegrowanego przypadku użycia, który pokaże realną wartość.

Krawędź (edge) kontra chmura – gdzie uruchamiać modele

AI w automatyzacji musi zmierzyć się z bardzo prozaicznymi ograniczeniami: opóźnienia, dostępność łącza, wymagania bezpieczeństwa. W przemyśle często nie ma zgody na wysyłanie surowych danych procesowych poza zakład, albo decyzje muszą być podejmowane w milisekundach. Stąd dylemat: liczyć wszystko w chmurze czy na brzegu sieci (edge)?

Sprawdza się podejście hybrydowe. Modele są trenowane w chmurze lub w centralnej serwerowni, gdzie dostępna jest duża moc obliczeniowa i dane z wielu zakładów. Gotowe, „zamrożone” wersje modeli wdraża się następnie na sterownikach edge, przemysłowych PC lub serwerach on‑premise, blisko maszyn czy systemów produkcyjnych. Dzięki temu predykcje i reakcje są szybkie, a jednocześnie wiedza zebrana z wielu lokalizacji może zostać wspólnie wykorzystana podczas kolejnego procesu uczenia.

W IT wygląda to podobnie: dane logów i metryk z wielu środowisk trafiają do centralnej platformy analitycznej, tam uczą się modele anomalii czy korelacji zdarzeń, ale samo wykrywanie awarii w krytycznych systemach może być realizowane lokalnie, w data center klienta, bez zależności od łącza do chmury.

Standardy komunikacji i interoperacyjność

AI bardzo źle znosi „wyspy danych”. Jeśli każdy dział ma własny format plików, inne nazwy zmiennych procesowych, inną granularność czasową, to budowa modelu przypomina układanie puzzli z pięciu różnych kompletów naraz. Im wcześniej pojawi się choćby prosty standard, tym mniejszy wysiłek będzie potrzebny na inżynierię danych.

W przemyśle rolę takiego „kleju” mogą pełnić popularne rozwiązania, jak OPC UA, MQTT czy ujednolicone słowniki tagów procesowych. W IT podobną funkcję spełniają ustandaryzowane formaty logów, centralne systemy zbierania metryk (np. Prometheus, OpenTelemetry) i spójne nazewnictwo usług. AI nie musi znać wszystkich szczegółów procesu, ale powinna dostać dane, które da się spiąć w spójną oś czasu i logiczną strukturę.

Dobrym krokiem jest zdefiniowanie „minimalnego pakietu” danych, które każdy nowy system automatyki czy nowe narzędzie IT musi udostępniać w ustandaryzowany sposób. To trochę jak wymóg, by każda nowa maszyna miała odpowiedni interfejs serwisowy – tylko że tutaj chodzi o interfejs danych dla przyszłych modeli.

Bezpieczeństwo, ryzyko i „hamulce awaryjne” w systemach z AI

Projektowanie z założeniem, że model może się mylić

Kluczowa różnica między klasyczną automatyką a AI polega na tym, że w modelu uczonym na danych błędy są nieuniknione. Zamiast udawać, że da się je wyeliminować, lepiej zaprojektować system tak, by pomyłki były możliwie niegroźne.

W praktyce oznacza to kilka zasad. Po pierwsze, w krytycznych zastosowaniach (bezpieczeństwo ludzi, ryzyko uszkodzenia sprzętu) AI nie powinna zastępować podstawowych zabezpieczeń – ma jedynie rozszerzać ich możliwości. Po drugie, każda automatyczna decyzja modelu powinna mieć zdefiniowany „hamulec awaryjny”: sposób na szybkie przełączenie w tryb ręczny lub tryb konserwatywny, oparty na prostych regułach.

W zakładzie produkcyjnym może to być np. logika: gdy model przewiduje możliwość poprawy jakości przez zwiększenie prędkości linii, ale równocześnie podstawowy system zabezpieczeń wykrywa zbyt wysoką temperaturę, priorytet zawsze ma zabezpieczenie. W świecie IT – gdy system AI proponuje automatyczne wyłączenie części usług, bo widzi potencjalny atak, ale istnieje ryzyko przerwania krytycznej transakcji finansowej, decyzja pozostaje po stronie operatora.

Wyjaśnialność modeli – dlaczego system podjął taką decyzję

Gdy AI zaczyna wpływać na realne procesy – zatrzymywać maszyny, przekierowywać ruch w sieci, zgłaszać awarie – naturalnie pojawia się pytanie: „dlaczego?”. Operator, który widzi tylko czerwony alarm „wysokie ryzyko awarii za 2 dni”, będzie miał ograniczone zaufanie. Zupełnie inaczej reaguje, jeśli system potrafi wskazać konkretne sygnały: wzrost drgań w określonej osi, nietypową temperaturę łożyska, korelację z poprzednimi przypadkami.

Dlatego tam, gdzie to możliwe, warto wykorzystywać techniki wyjaśnialnej AI (XAI): proste wykresy pokazujące, które zmienne najbardziej wpłynęły na predykcję, przykłady podobnych sytuacji z przeszłości, progi, przy których model „zmienia zdanie”. To nie musi być naukowa analiza – wystarczy wizualizacja, która pozwoli inżynierowi powiedzieć: „rozumiem, skąd się wziął ten alert”.

Takie podejście zwiększa też szansę na ulepszenie samego modelu. Jeśli operatorzy widzą, że AI nadmiernie faworyzuje jeden parametr, mogą zasugerować dodanie kolejnych sygnałów lub zmianę logiki. Zamiast odrzucać rozwiązanie jako „magiczne”, zaczynają je współprojektować.

Zgodność z regulacjami i politykami firmy

Automatyzacja z AI wchodzi w obszary regulowane: ochrona danych osobowych, bezpieczeństwo informacji, czasem wymagania branżowe (np. farmacja, automotive, energetyka). Do tego dochodzą wewnętrzne polityki korporacyjne. Warto więc traktować projekty AI jak każdy inny element infrastruktury krytycznej, a nie jak zabawę w dziale innowacji.

Oznacza to m.in. kontrolę dostępu do danych treningowych, rejestrowanie tego, kto i kiedy wdrożył nową wersję modelu, archiwizację modeli historycznych (tak, aby dało się odtworzyć, jak system podejmował decyzje w danym okresie), a także cykliczne przeglądy bezpieczeństwa. W wielu firmach dobrze sprawdza się zasada, że zmiana w modelu podlega podobnemu procesowi jak zmiana w aplikacji produkcyjnej – z testami, akceptacją i planem wycofania w razie problemów.

Jak wybierać pierwsze projekty AI w automatyzacji – pragmatyczna ścieżka startu

Szukanie „słodkich miejsc” – duży wpływ, umiarkowane ryzyko

Pokusa, by na początek sięgnąć po najbardziej spektakularne zastosowanie AI, jest silna. Tymczasem najlepszym paliwem do rozwoju jest jedno czy dwa spokojnie dowiezione wdrożenia, które przyniosą odczuwalną, choć może mniej medialną korzyść.

Dobrym kandydatem jest proces, który:

- jest dobrze zrozumiany przez zespół (wiadomo, co jest „normalne”, a co nie),

- generuje już teraz sensowne dane, choćby z prostych czujników czy logów,

- ma realny koszt błędów – ale ich skutki nie są katastrofalne,

- ma „właściciela”, którego mierzalne cele można poprawić (np. redukcja braków, skrócenie czasu reakcji na incydenty).

W wielu firmach takim polem okazał się monitoring infrastruktury IT (model priorytetyzujący alerty), niewielka linia pakująca (kontrola jakości z kamerą) albo konkretna grupa maszyn pomocniczych (predykcja awarii wentylatorów czy pomp). To nie są projekty, które trafią na okładkę branżowego magazynu, ale za to szybko budują zaufanie do technologii.

Jeśli chcesz pójść krok dalej, pomocny może być też wpis: Jak przygotować infrastrukturę IT pod projekty AI w zakładach przemysłowych.

Iteracyjne podejście zamiast „Big Bang”

AI w automatyzacji szczególnie dobrze czuje się w trybie iteracyjnym. Zamiast rocznego projektu z wielką analizą i długim okresem „nic się nie dzieje”, lepiej zacząć od MVP (minimum viable product): prostego modelu, jednego zakładu, ograniczonego zakresu funkcji.

Pierwsza wersja nie musi od razu podejmować automatycznych decyzji. Może jedynie generować rekomendacje lub dodatkowe alerty, które zespół będzie obserwował. Po kilku tygodniach wspólnej pracy widać, gdzie model się myli, co jest dla operatorów przydatne, a co tylko przeszkadza. Te wnioski trafiają do kolejnej wersji modelu i interfejsu użytkownika.

Taki rytm – krótki cykl budowy, test w realnych warunkach, poprawki – znacznie zmniejsza ryzyko, że po 12 miesiącach pracy świat się zmieni, a rozwiązanie straci aktualność, zanim ktokolwiek je uruchomi w produkcji.

Mierzenie efektów i „twarde” wskaźniki

Bez konkretnych liczb AI bardzo szybko staje się w organizacji kolejną modną etykietą. Dlatego nawet przy niewielkim pilotażu warto zdefiniować, jakie wskaźniki mają się zmienić i jak będą mierzone. Mogą to być proste metryki: liczba nieplanowanych przestojów, czas reakcji na incydent, liczba fałszywych alarmów, średnia długość cyklu, ilość braków na zmianę.

Jeżeli to możliwe, dobrze jest porównać okres „przed” i „po” wdrożeniu na tej samej linii, tym samym segmencie sieci czy tej samej grupie serwerów. W małych projektach wystarczy zwykły arkusz i kilka prostych wykresów, w większych – dashboard w systemie raportowym. Kluczowe, żeby ktoś czuł się odpowiedzialny za te liczby i regularnie je przeglądał z zespołem. Raz na jakiś czas dobrze zadać sobie proste pytanie: „Gdybyśmy dziś mieli zrezygnować z tego rozwiązania, czy ktokolwiek by tego żałował?”. Jeśli odpowiedź brzmi „nie”, to sygnał, że efekt jest zbyt słaby albo źle mierzony.

W trakcie takich przeglądów bardzo często wychodzą na jaw efekty uboczne: dodatkowa praca ręczna przy etykietowaniu danych, większe obciążenie jednego zespołu, a gdzie indziej realna oszczędność czasu. Wtedy obraz „zysku” trzeba skorygować. Czasem lepiej ograniczyć funkcjonalność modelu, ale uprościć proces wokół, niż śrubować dokładność kosztem komplikacji organizacyjnych. AI ma pracować dla ludzi, a nie odwrotnie.

Dobrą praktyką jest też zaplanowanie z góry, co stanie się, jeśli projekt się powiedzie. Czy przewidziane są środki na skalowanie? Kto przejmie utrzymanie rozwiązania po pilotażu? Bez takiej ścieżki sukces potrafi stać się problemem – model działa świetnie na jednej linii, ale nikt nie jest gotów, by wdrożyć go w trzech kolejnych zakładach. Rozsądne jest myślenie o pierwszym projekcie nie tylko jako o „proof of concept”, lecz także jako o poligonie, na którym firma uczy się całego cyklu życia systemu z AI.

Z czasem pojawia się jeszcze jedna, mniej oczywista korzyść: zespół zaczyna inaczej patrzeć na dane i procesy. Operatorzy dopytują o nowe czujniki, administratorzy sieci sami proponują lepsze etykietowanie logów, a inżynierowie procesu przynoszą własne pomysły na kolejne modele. Wtedy widać, że AI przestała być „projektem” i staje się naturalnym elementem warsztatu – tak jak kiedyś arkusz kalkulacyjny czy system SCADA.

Automatyzacja wspierana sztuczną inteligencją nie jest jednorazowym skokiem technologii, tylko serią rozsądnych kroków, które zespół robi wspólnie. Kto połączy rzetelne dane, znajomość procesu i odwagę do małych eksperymentów, ten z biegiem czasu buduje środowisko, w którym systemy IT i maszyny przemysłowe naprawdę zaczynają „myśleć razem” z ludźmi, a nie zamiast nich.

Najczęściej zadawane pytania (FAQ)

Na czym polega różnica między zwykłą automatyzacją a „inteligentną” automatyzacją z AI?

Zwykła automatyzacja opiera się na sztywnych regułach typu if/then: jeśli temperatura przekroczy 80°C – wyłącz linię, jeśli serwer nie odpowiada 3 razy – zrestartuj usługę. Działa dobrze tam, gdzie da się z góry przewidzieć wszystkie scenariusze i wyjątki.

Automatyzacja z AI uczy się zachowania systemu z danych historycznych. Model nie patrzy tylko na pojedynczy próg, ale na cały kontekst: trend metryk, logi, wcześniejsze awarie. Dzięki temu potrafi np. przewidzieć degradację wydajności z wyprzedzeniem i uruchomić odpowiednią akcję (skalowanie, przełączenie ruchu, dodatkowy backup), zanim problem naprawdę „wybuchnie”.

Jakie są najczęstsze zastosowania sztucznej inteligencji w automatyzacji procesów IT?

AI najwięcej daje tam, gdzie ludzie toną w danych: metrykach, logach, alertach i zgłoszeniach. Model może przejrzeć setki wykresów w czasie, w którym człowiek przełączy jedną zakładkę w monitoringu.

Typowe zastosowania to m.in.:

- monitoring infrastruktury z detekcją anomalii bez ręcznego ustawiania progów,

- automatyczne reakcje na incydenty (AIOps połączone z runbookami i skryptami naprawczymi),

- analiza logów z grupowaniem podobnych zdarzeń i odszumianiem alertów,

- prognozowanie obciążenia zasobów, np. pod kątem planowania zakupów lub autoskalowania chmury.

To zwykle zaczyna się od roli „mądrego filtra”, a kończy na realnym sterowaniu infrastrukturą.

Gdzie w przemyśle AI daje najszybsze, mierzalne korzyści?

W zakładach produkcyjnych dane spływają z maszyn non stop, ale często tylko ich ułamek jest realnie wykorzystywany. AI świetnie sprawdza się tam, gdzie można tę „kopalnię danych” przełożyć na mniej przestojów, mniej braków lub niższe zużycie energii.

Najczęstsze wdrożenia to:

- predykcyjne utrzymanie ruchu – przewidywanie awarii z drgań, temperatur, hałasu czy prądu silników,

- kontrola jakości z wizją komputerową – wychwytywanie wad produktów na taśmie w czasie rzeczywistym,

- optymalizacja parametrów procesu – takie dobranie temperatur, prędkości czy ciśnień, żeby produkować stabilnie, ale z mniejszą ilością odpadów i niższym zużyciem energii,

- cyfrowe bliźniaki linii – symulacje pozwalające „na sucho” sprawdzać zmiany w ustawieniach.

Dla operatora często wygląda to tak, że zamiast reagować na gotową awarię, dostaje ostrzeżenie godzinę wcześniej i ma czas spokojnie zareagować.

Czy AI w automatyzacji IT i przemysłowej naprawdę zastąpi ludzi?

Obecne systemy AI świetnie radzą sobie z rozpoznawaniem wzorców, wykrywaniem anomalii, prognozowaniem trendów i klasyfikacją zdarzeń czy produktów. To dokładnie te miejsca, gdzie człowiek męczy się przy żmudnym przeglądaniu wykresów lub taśm produkcyjnych.

Dużo gorzej idzie im z rozumieniem szerokiego kontekstu biznesowego, priorytetów, kompromisów czy aspektów etycznych. W praktyce oznacza to przesunięcie roli ludzi: mniej ręcznego „klikania” i gaszenia pożarów, więcej nadzoru, kalibracji modeli, projektowania procesu i decydowania, kiedy automat może działać sam, a kiedy potrzebna jest akceptacja człowieka.

Jak zacząć wdrażać AI w automatyzacji procesów IT lub produkcyjnych?

Zamiast zaczynać od „magicznego” projektu AI, lepiej podejść do tematu jak do układania klocków LEGO. Najpierw trzeba wybrać konkretny, wąski problem: np. zbyt częste przestoje linii, zbyt dużo fałszywych alertów w monitoringu, niestabilne czasy odpowiedzi aplikacji.

Kolejny krok to sprawdzenie, jakie dane już są zbierane (metryki, logi, sygnały z czujników, obrazy z kamer) i czy można je wykorzystać do trenowania modelu. Dopiero później dobiera się typ modelu, platformę MLOps/AIOps i sposób wpięcia go w istniejącą automatyzację (skrypty, orkiestrację, systemy ITSM). Dobrą praktyką jest pilotaż na jednym procesie, a dopiero po udanych testach – skalowanie na kolejne obszary.

Jakie są realne ograniczenia AI w automatyzacji, o których trzeba wiedzieć?

AI nie jest nieomylnym „czarnym pudełkiem”, które zawsze ma rację. Modele uczą się z danych, więc jeśli dane są słabej jakości, niekompletne albo mocno zmienia się środowisko, ich przewidywania mogą być chybione. Zdarzają się też okresy „rozkalibrowania” po dużych zmianach w infrastrukturze lub procesie produkcyjnym.

Druga kwestia to brak pełnego zrozumienia kontekstu. Model może świetnie rozpoznać, że coś „odbiega od normy”, ale nie zawsze rozumie, że w tym tygodniu jest planowany test obciążeniowy albo produkcja prototypów. Dlatego dojrzałe wdrożenia łączą automatyczne decyzje tam, gdzie ryzyko jest niskie, z nadzorem operatora tam, gdzie stawka jest wysoka.

Czym różni się AIOps od klasycznego monitoringu i DevOps?

Klasyczny monitoring i praktyki DevOps opierają się głównie na ręcznie zdefiniowanych progach, alertach i skryptach. Inżynier ustawia reguły, a system pilnuje, czy nie zostały przekroczone. Przy rosnącej liczbie serwisów i metryk taka ręczna praca szybko przestaje być skalowalna.

AIOps dorzuca do tego warstwę uczenia maszynowego: analizuje metryki, logi, bilety serwisowe i zależności między usługami, żeby automatycznie wykrywać anomalie, korelować alerty i podpowiadać (lub wykonywać) akcje naprawcze. Można to traktować jak „turbo-dopalacz” dla zespołów DevOps: mniej szumu, wcześniej zauważone problemy i więcej powtarzalnych reakcji wykonywanych bez udziału człowieka.

Opracowano na podstawie

- Artificial Intelligence: A Modern Approach. Pearson (2021) – Klasyczne definicje AI, modele, uczenie i wnioskowanie

- ISO/IEC 22989:2022 Artificial intelligence — Concepts and terminology. ISO (2022) – Standardowe definicje AI, modelu, inferencji

- MLOps: Continuous Delivery and Automation Pipelines in Machine Learning. O’Reilly Media (2020) – Praktyki MLOps, wdrażanie i utrzymanie modeli ML

- AIOps: Real-world Challenges and Opportunities. IEEE (2020) – Przegląd koncepcji AIOps i automatyzacji operacji IT

- Predictive Maintenance of Industrial Systems. Wiley (2012) – Modele predykcyjne, przewidywanie awarii, utrzymanie ruchu

- NIST Big Data Interoperability Framework, Volume 4: Security and Privacy. NIST (2019) – Zarządzanie danymi operacyjnymi, logami i metrykami w dużej skali

- Industrial AI. Springer (2020) – Zastosowania AI w przemyśle, detekcja anomalii, predykcja awarii

- ITIL Foundation: ITIL 4 Edition. AXELOS (2019) – Procesy operacyjne IT, incydenty, zmiany, kontekst dla AIOps